วงการ AI กำลังก้าวหน้าอย่างรวดเร็ว ตั้งแต่ Google เปิดตัว Gemini 1.0 ออกมา LLMs ก็นับว่าชาญฉลาดกว่าเดิมมาก ๆ และ Google เองก็ไม่หยุดพัฒนา Gemini จนมาถึงโมเดลรุ่นล่าสุด Gemini 1.5 ที่ถือว่าเป็นโมเดลภาษาที่รองรับ Input ขนาดใหญ่แต่ใช้หน่วยประมวลผลน้อยกว่าเดิม!

ฉลาดล้ำด้วยสถาปัตยกรรม MoE

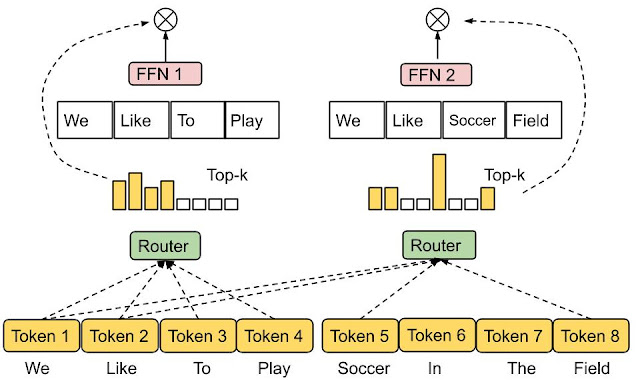

Gemini 1.5 มีความฉลาดล้ำกว่าเดิมด้วยการใช้สถาปัตยกรรมแบบ MoE (Mixture-of-Experts) เป็นโครงข่ายประสาทเทียม (Neural Networks) รูปแบบใหม่ที่ใช้หน่วยประมวลผลน้อยลง โดยแบ่งเป็นโครงข่ายประสาทเทียมย่อย ๆ ที่มีความเชี่ยวชาญแต่ละเรื่อง (Experts) และมีตัวที่เหมือน Router กำหนดว่าแต่ละ Token จะส่งไปหา Experts อันไหน และผลลัพธ์จาก Experts ทั้งหมดก็จะถูกรวมกันสร้างเป็นผลลัพธ์สุดท้าย

ดังนั้นการใช้ MoE เปรียบเสมือน Gemini ที่มีผู้เชี่ยวชาญเฉพาะด้านแตกต่างกัน เช่น วิศวกร, นักบัญชี หรือนักกฎหมายที่คอยหาคำตอบให้ ทำให้โมเดลสามารถประมวลผลข้อมูลขนาดใหญ่ได้อย่างมีประสิทธิภาพ Gemini 1.5 Pro จึงรองรับได้ถึง 1 ล้าน Token Context Window (ปัจจุบัน Google ปล่อย Gemini 1.5 Pro ที่ 128,000 Token และจะปล่อยตัว 1 ล้าน Token ในเร็ว ๆ นี้)

1 ล้านโทเคนเก่งแค่ไหน ?

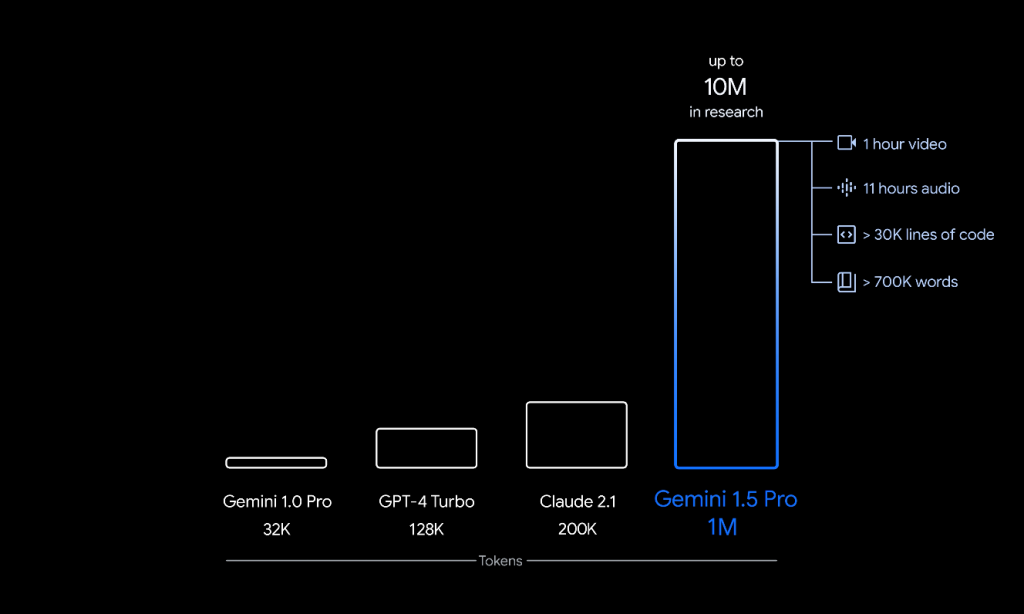

Context Window เปรียบเสมือนจำนวนข้อความสูงสุดที่โมเดลภาษาตัวนี้จะนำไปประมวลในคราเดียว ดังนั้น 1 ล้าน Token Context Window เปรียบได้กับการประมวผลไฟล์วิดีโอความยาว 1 ชั่วโมง, ไฟล์เสียงความยาว 11 ชั่วโมง, Source Code มากกว่า 3 หมื่นบรรทัด และหนังสือหรือบทความมากกว่า 7 แสนคำ

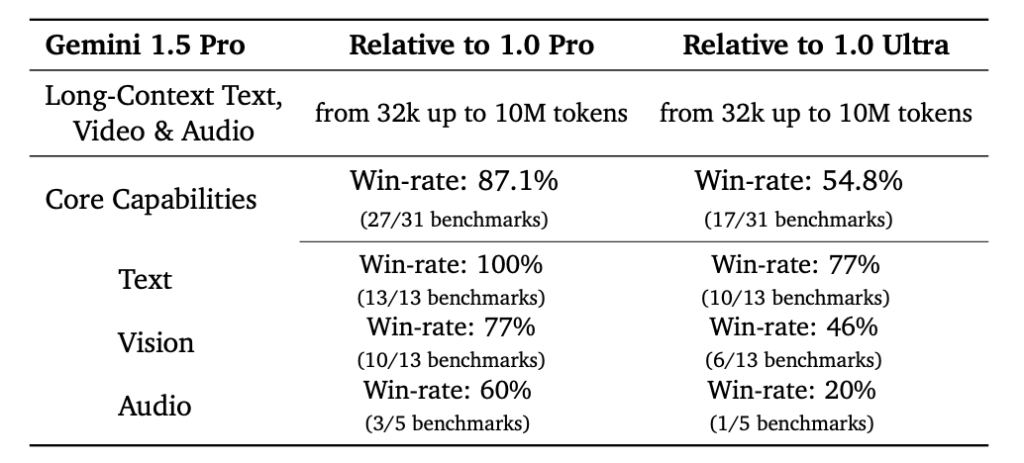

ถ้าเทียบกับ Gemini 1.0 ที่รับได้ 32,000 Tokens ตัว Gemini 1.5 ก็รองรับ Context ได้ก้าวกระโดดมาก ๆ เมื่อดู Report จาก Google ต่อไปนี้

ตัว Gemini 1.5 Pro มีประสิทธิภาพเหนือกว่าตัว Gemini 1.0 Pro ในแต่ละ Benchmarks คิดเป็น 87.1% ดังนั้นการที่มีประสิทธิภาพสูงขึ้นและรองรับ Token ได้ใหญ่ขึ้น ทำให้ Gemini 1.5 Pro รองรับข้อมูลขนาดใหญ่ได้หลากหลาย Use-cases ไม่ว่าจะให้ Gemini ช่วยดูวิดีโอและตอบคำถามแทนเรา ฟังบรรยายงานต่าง ๆ หรือแม้กระทั่งการ Debug โค้ดแทนเป็นเรื่องที่ไม่ไกลเกินตัว

1 ล้านโทเคนทำอะไรได้บ้าง ?

อัปโหลดได้หลายไฟล์และตอบได้หลากหลายคำถามในครั้งเดียว

เข้าใจโค้ดทั้งหมดด้วยการอัปโหลดจาก Computer หรือ Google Drive ได้อย่างรวดเร็ว

เข้าใจวิดีโอได้สูงสุด 1 ชั่วโมง Gemini 1.5 Pro จะแบ่งวิดีโอออกเป็นพัน ๆ เฟรม (โดยไม่มีเสียง) จากนั้นเราสามารถถาม Gemini ในเชิงเหตุผลหรือรายละเอียดในวิดีโอได้

ทาง Google ยังแสดงความสามารถของ Gemini 1.5 เป็น Demo ต่าง ๆ ดังนี้

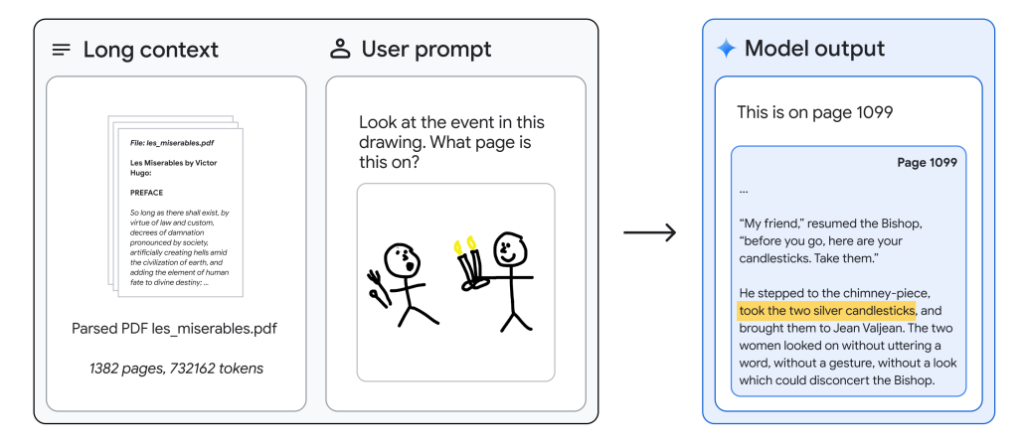

การให้เหตุผลที่ซับซ้อนกับข้อมูลขนาดใหญ่

การให้ Gemini 1.5 Pro อ่านเอกสาร PDF กว่า 1,000 หน้า แล้วถามฉากต่าง ๆ ในเรื่องแสดงให้เห็นถึงตรรกะความเข้าใจที่ซับซ้อน และอีกตัวอย่างจะเป็นการวิเคราะห์ข้อมูลบทสนทนาในภารกิจ Apollo 11 จำนวน 402 หน้า ก็สามารถตอบคำถามต่าง ๆ และ Time Code ได้อย่างถูกต้อง

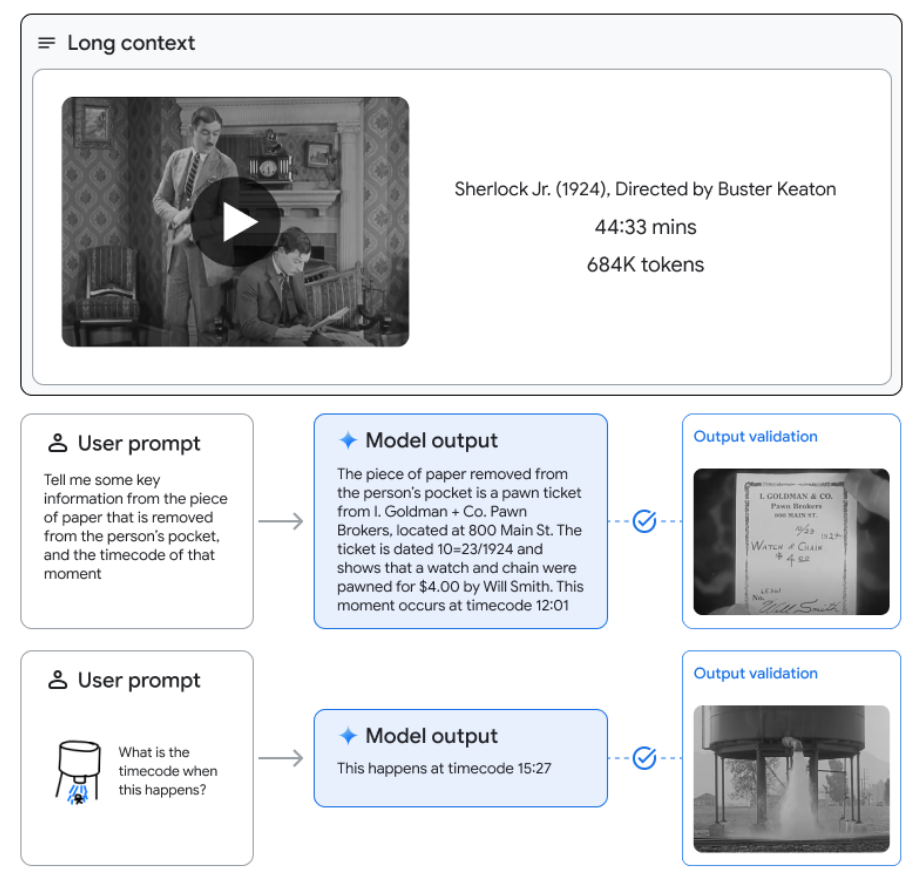

การเข้าใจและให้เหตุผลกับข้อมูลแบบต่าง ๆ

ตัวอย่างนี้ Gemini 1.5 Pro สามารถเข้าใจหนังเงียบความยาว 44 นาทีได้ เข้าใจพล็อตเรื่องและเหตุการณ์ต่าง ๆ ที่ถาม เข้าใจข้อความในภาพยนตร์ รวมถึงทราบว่าภาพวาดที่ถามเพิ่มเข้าไปเป็นฉาก ณ เวลาใดในภาพยนตร์อีกด้วย

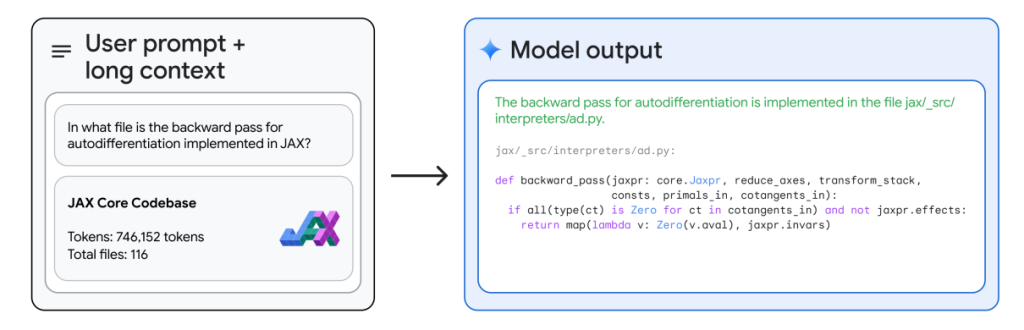

การแก้ปัญหากับโค้ดโปรแกรมขนาดใหญ่

อีกตัวอย่างที่โยน Core Codebase ให้ก็สามารถตอบคำถามเกี่ยวกับโค้ดได้ รวมถึงการเข้าใจ Animation 3D ในรูปแบบโค้ดที่ส่งไป Gemini 1.5 Pro สามารถตอบคำถามและปรับแต่ง Parameter ต่าง ๆ เพื่อควบคุม Animation Speed ได้ รวมถึงการถามด้วยภาพได้ว่า Animation นี้อยู่ที่ไหนใน Repository ซึ่งข้อมูลที่ป้อนเป็นโค้ดตัวอย่าง แต่การถามด้วยภาพนั้นนับว่าเป็นข้อมูลที่มีความแตกต่างจาก Input มาก ๆ แต่ผลลัพธ์จากตัวอย่างนี้ก็สามารถแสดงศักยภาพของ Gemini ออกมาได้เป็นอย่างดี

Gemini 1.5 Pro ใช้ได้ที่ไหน ?

เราสามารถใช้ Gemini 1.5 Pro ผ่าน Google AI Studio ได้สำหรับ Model 1.0 ส่วนสำหรับ Model 1.5 ต้องลงทะเบียนเข้าคิวต่อ Waitlist ได้เลย

หากองค์กรของคุณสนใจลองใช้ Gemini ก่อนใคร สามารถปรึกษาทางแทนเจอรีนได้ทันที https://www.tangerine.co.th/contact-us/

เรามีผู้เชี่ยวชาญที่ได้รับการรับรองในทุก ๆ สาขา ไม่ว่า Data Analytics หรือ Artificial Intelligence พร้อมให้คำปรึกษาทุกท่าน